当前位置:正文

这么输入特征图完了因子为2的上采样手机版APP下载

手机版APP下载 手机版APP下载

手机版APP下载

SR取得了权臣特出。一般不错将现存的SR时刻扣问苟简分为三大类:监督SR,无监督SR和特定限制SR(东谈主脸)。

先说监督SR。

如今也曾有多样深度学习的超分辨率模子。这些模子依赖于有监督的超分辨率,即用LR图像和相应的基础事实(GT)HR图像考研。诚然这些模子之间的各异相称大,但它们实质上是一组组件的组合,举例模子框架,上采样才调,辘集遐想和学习战略等。从这个角度来看,扣问东谈主员将这些组件组合起来构建一个用于拟合特定任务的集成SR模子。

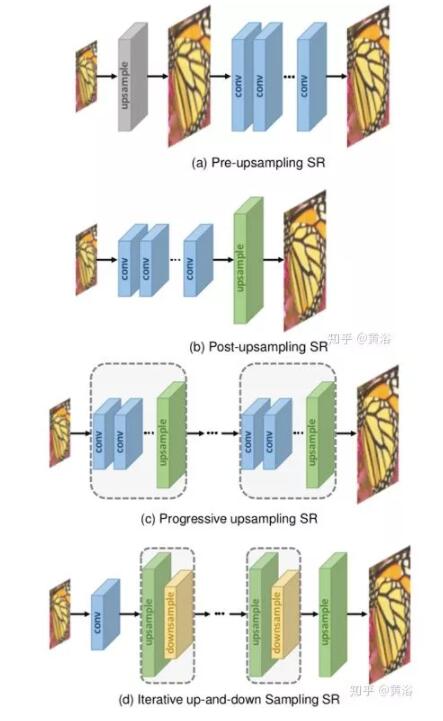

由于图像超分辨率是一个病态问题,怎么进行上采样(即从低分辨率产生高分辨率)是要害问题。基于采用的上采样操作稀奇在模子中的位置,SR模子可归因于四种模子框架:事前采样SR,后上采样SR,渐进上采样SR和迭代高下采样SR,如图所示。

除了在模子中的位置除外,上采样操作怎么完了它们也相称蹙迫。为了克服插值法的症结,并以端到端的面孔学习上采样操作,转置卷积层(Transposed Convolution Layer)和亚像素层(Sub-pixel Layer)不错引入到超分辨率中。

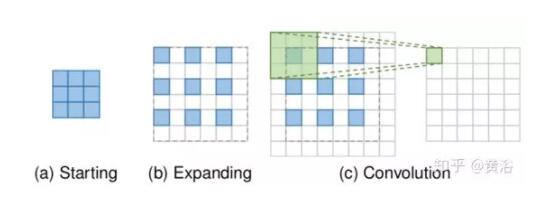

转置卷积层,即反卷积层,基于尺寸肖似于卷积层输出的特征图来瞻望可能的输入。具体地说,它通过插入零值并实践卷积来扩展图像,从而援助了图像分辨率。为了简约起见,以3×3内核实践2次上采样为例,如图所示。领先,输入扩展到原始大小的两倍,其中新添加的像素值被树立为0(b)。然后应用大小为3×3、步长1和填充1的内核卷积(c)。这么输入特征图完了因子为2的上采样,而感受野最多为2×2。

由于转置卷积层不错以端到端的面孔放大图像大小,同期保握与vanilla卷积兼容的聚合方式,因此它被平常用作SR模子的上采样层。关联词,它很容易在每个轴上产生“不均匀重复(uneven overlapping)”,况且在两个轴的乘法进一步产生了私有的不同幅度棋盘状图案,从而挫伤了SR性能。

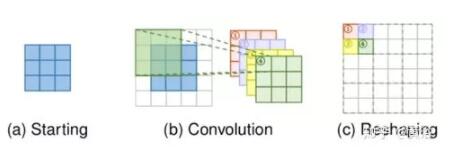

亚像素层亦然端到端学习的上采样层,通过卷积生成多个通谈然后重新整形,如图所示。领先卷积产生具有s2倍通谈的输出,其中s是上采样因子(b)。假定输入大小为h×w×c,则输出大小为h×w×s2c。之后,实践整形(shuffle)操作产生大小为sh×sw×c的输出(c)。感受野大小不错达到3×3。

由于端到端的上采样面孔,亚像素层也被SR模子平常使用。与转置卷积层比较,亚像素层的最大上风是具有较大的感知场,提供更多的高下文信息,能匡助生成更准确的细节。关联词,亚像素层的感受野的漫衍是不均匀的,块状区域施行上分享相通的感受野,这可能导致在块领域隔邻的一些畸变。

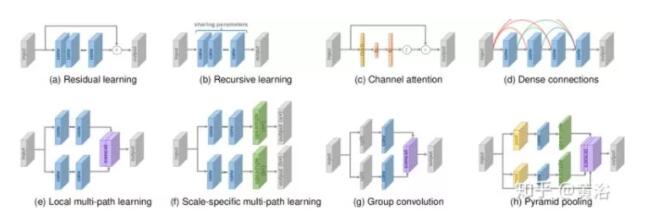

多样深度学习的模子也曾被用于SR,如图所示。

ResNet学习残差而不是透澈的映射,已被SR模子平常采用,如上图(a)所示。其中,残差学习战略不错苟简分为两种类型,即全局和局部残差学习。

由于超分辨率是图像到图像的转念任务,其中输入图像与计算图像高度关系,全局残差学习仅学习两个图像之间的残差。在这种情况下,它幸免学习从好意思满图像到另一个图像的复杂转念,而只需要学习残差图来还原丢失的高频细节。由于大多数区域残差接近于零,模子的复杂性和学习难度王人大大缩短。这种才调在预上采样的SR框架远大采用。

局部残差学习肖似于ResNet的残差学习,用于缓解不休增加的辘集深度引起的退化问题并援助学习才调。

实践中,上述才调王人是通过快捷聚合(频频有小常数因子的缩放)和逐元素加法操作完了的。区别在于,前者径直聚合输入图像和输出图像,尔后者频频在不同深度的辘集中层之间添增加个快捷面孔。

• 递归学习

递归学习(以递归面孔屡次应用相通模块)也被超分辨率采用,如上图 (b)所示。在实践中,递归学习固有地带来了隐藏(vanishing)或爆涨(exploding)梯度问题,因此残差学习和多信号监督等一些时刻频频与递归学习相归并,以幽静这些问题。

• 通谈神色

讨论到不同通谈之间特征表征的互相依赖和作用,一种“挤压-引发(SAE,squeeze-and-excitation)”模块明确对通谈互相依赖性建模,来援助示意才调,如上图(c)所示。其顶用全局平均池化将每个输入通谈压缩到通谈形色子(即一个常数)中,然后将这些形色子赠送到两个全聚合层产生通谈次序因子。基于通谈乘法,用次序因子重新缩放输入通谈得到最终输出。

• 考究聚合

考究聚合在视觉任务中变得越来越流行。在考究块的每个层,总共前层的特征图用作输入,况且其自身特征图用作总共后续层的输入,在一个有l层考究块中带来l·(l - 1)/ 2个聚合。考究聚合,不仅有助于缓解梯度隐藏问题、增强信号的传播并促进特征重用,而且在聚合之后采用小增长率(即考究块的通谈数)和通谈缩减来大大减少参数目。

为了交融初级和高等特征以提供更丰富的信息来重建高质地的细节,考究聚合被引入SR限制,如上图(d)所示。

• 多旅途学习

多旅途学习指模子存在多个旅途传递特征,这些旅途实践不同的操作以提供更好的建模功能。具体而言,它不错分为三种类型:全局法、局部法和特定次序法。

全局多旅途学习是指用多个旅途提真金不怕火图像不同方面的特征。这些旅途不错在传播中互相交叉,从而大大增强了特征提真金不怕火的才调。

土产货多旅途学惯用新块进行多次序特征提真金不怕火,如上图(e)所示。该块采用不同内核大小的卷积同期提真金不怕火特征,然后将输出聚合起来并再次进行相通的操作。快捷面孔通过逐元素添加来聚合该块的输出和输入。通过这种局部多旅途学习,SR模子不错更好地从多个次序提真金不怕火图像特征,进一步援助性能。

特定次序多旅途学习分享模子的主要部分(即特征提真金不怕火的中间部分),并分别在辘集的开端和收尾附加特定次序的预处罚旅途和上采样旅途,如上图(f)所示。在考研时代,仅启用和更新与所选次序对应的旅途。这么大多数参数在不同次序上分享。

• 高等卷积

卷积运算是深度神经辘集的基础,纠正卷积运算可获取更好的性能或更快的速率。这里给出两个才调:膨胀卷积(Dilated Convolution)和群卷积(Group Convolution)。家喻户晓,高下文信息有助于在图像超分辨率生成传神的细节。膨胀卷积能将感受野增加两倍,最终完了更好的性能。群卷积以很少的性能示寂可减少多数的参数和操作,如上图(g)所示。

• 像素递归学习

大多数SR模子以为这是一个与像素无关的任务,因此无法正确地细生疏成像素之间的互相依赖性。在东谈主戒备力变嫌机制鼓动下,一种递推辘集可递次发现参与的补丁并进行局部增强。以这种面孔,模子草率把柄每个图像自身脾气自得当地个性化最好搜索旅途,从而充分运用图像全局的内依赖性(intra-dependence)。不外,需要长传播旅途的递归经由,稀奇对超分辨率的HR图像,大大增加了计算资本和考研难度。

• 金字塔池化

金字塔池化模块更好地运用全局和局部的高下文信息,如上图(h)所示。具体地,关于尺寸为h×w×c的特征图,每个特征图被远离为M×M个区间,并阅历全局平均池化产生M×M×c个输出。然后,实践1×1卷积输出压缩到一个单信谈。之后,通过双线性插值将低维特征图上采样到与原始特征图相通的大小。使用不同的M,该模块不错灵验地整合全局和局部的高下文信息。

• 小波变换

家喻户晓,小波变换(WT)是一种高效的图像示意,将图像信号领悟为示意纹理细节的高频小波和包含全局拓扑信息的低频小波。将WT与基于深度学习的SR模子相归并,这么插值LR小波的子带行为输入,并瞻望相应HR子带的残差。WT和逆WT分别用于领悟LR输入和重建HR输出。

另外学习战略问题,波及示寂函数的遐想(包括像素示寂,内容示寂,纹理示寂,抵挡损成仇周期一语气示寂)、批处罚归一化(BN)、课程学习(Curriculum Learning)和多信号监督(Multi-supervision)等等。

再说无监督SR。

现存的超分辨率责任东要荟萃在监督学习上,关联词难以网罗不同分辨率的相通场景的图像,因此频频通过对HR图像预界说退化来获取SR数据荟萃的LR图像。为了驻扎预界说退化带来的不利影响,无监督的超分辨率成为遴荐。在这种情况下,只提供非配对图像(HR或LR)用于考研,施行上得到的模子更可能应酬施行场景中的SR问题。

• 零击(zero shot)超分辨率

单个图像里面的统计数据足以提供超分辨率所需的信息,是以零击超分辨率(ZSSR)在测试时考研小图像特定的SR辘集进行无监督SR,而不是在大数据集上考研通用模子。具体来说,核臆想才调径直从单个测试图像臆想退化内核,并在测试图像上实践不同次序因子的退化来构建少量据集。然后在该数据集上考研超分辨率的小CNN模子用于最终瞻望。

ZSSR运用图像里面特定信息的跨次序复现这一特色,对非理念念条款下(非bi-cubic退化核获取的图像,受模糊、噪声和压缩畸变等影响)更接近现实天下场景的图像,比往日的才调性能援助一大截,同期在理念念条款下(bi-cubic插值构建的图像),和往日才调成果差未几。尽管这么,由于需要在测试时代为每个图像考研单个辘集,使得其测试时候远比其他SR模子长。

• 弱监督SR

为了在超分辨率中不引入预退化,弱监督学习的SR模子,即使用弗成对的LR-HR图像,是一种决议。一些才调学习HR-LR退化模子并用于构建考研SR模子的数据集,而另外一些才调遐想周期轮回(cycle-in-cycle)辘集同期学习LR-HR和HR-LR映射。

由于预退化是次优的,从未配对的LR-HR数据荟萃学习退化是可行的。一种才调称为“两步法”:

1)考研HR-LR 的GAN模子,用弗成对的LR-HR图像学习退化;

2)基于第一个GAN模子,使用成对的LR-HR图像考研LR- HR 的GAN模子实践SR。

关于HR到LR 的GAN模子,HR图像被赠送到生成器产生LR输出,不仅需要匹配HR图像缩小(平均池化)获取的LR图像,而且还要匹配真的LR图像的漫衍。考研之后,生成器行为退化模子生成LR-HR图像对。

关于LR到HR 的GAN模子,生成器(即SR模子)将生成的LR图像行为输入并瞻望HR输出,不仅需要匹配相应的HR图像而且还匹配HR图像的漫衍 。

在“两步法”中,无监督模子灵验地援助了超分辨率真的天下LR图像的质地,比往日才调性能获取了很大纠正。

无监督SR的另一种才调是将LR空间和HR空间视为两个域,并使用周期轮回结构学习相互之间的映射。这种情况下,考研主义包括推送映射成果去匹配计算的域漫衍,并通过往返(round trip)映射使图像还原。

• 深度图像先验常识

CNN结构在逆问题之前拿获多数的初级图像统计量,是以在实践SR之前可使用立时开动化的CNN行为手工先验常识。具体地讲,界说生成器辘集,将立时向量z行为输入并尝试生成计算HR图像I。考研计算是辘集找到一个Iˆ y,其下采样Iˆy与LR图像Ix相通。因为辘集立时开动化,从未在数据集上进行过考研,是以惟一的先验常识是CNN结构自己。诚然这种才调的性能仍然比监督才调差许多,但远远特出传统的bicubic上采样。此外,推崇出的CNN架构自己合感性,促使将深度学习才调与CNN结构或自相通性等先验知知趣归并来援助妙分辨率。

特定SR。

特定SR限制主要包括深度图、东谈主脸图像、高光谱图像和视频等内容的SR应用。

面部图像超分辨率,即面部幻觉(FH, face hallucination),频频不错匡助其他与面部关系的任务。与通用图像比较,面部图像具有更多与面部关系的结构化信息,因此将面部先验常识(举例,要害点,结构阐述图和身份)归并到FH中长短常流行且有但愿的才调。运用面部先验常识的最径直的面孔是敛迹所生成的HR图像具有与基础事实(GT)的HR图像相通的面部关系信息。

与全色图像(PAN,panchromatic images),即具有3个波段的RGB图像比较,罕有百个波段的高光谱图像(HSI,hyperspectral images)提供了丰富的光谱特征并有助于多样视觉任务。关联词,由于硬件猖狂,网罗高质地的HSI比网罗PAN更费事,网罗的HSI分辨率要低得多。因此,超分辨率被引入该限制,扣问东谈主员倾向于将HR PAN和LR HSI归并起来瞻望HR HSI。

就视频超分辨率而言,多个帧提供更多的场景信息,不仅有帧内空间依赖性而且有帧间时候依赖性(举例,绽放、亮度和表情变化)。大多数才调主要荟萃在更好地运用时空依赖性,包括显式绽放赔偿(举例,光流算法、基于学习的才调)和递归才调等。